NeurIPS 2025 DynaAct:DeepSeek R1之外,探索大模型

针对这个问题,来自蚂蚁和香港大学自然语言组的研究团队(后简称「团队」)给出了 TTS 的另一种思路:

与传统 token-by-token 式的 CoT 不同,DynaAct 提出以 Action Space Optimization 为核心的 TTS 范式:在每一步推理中动态构建可选动作集合,并通过学习算法从中选择最优动作,从而让推理路径更高效、更具结构化。

当前主流 TTS 方法通过「更长的思维链」来提升性能,但随之而来的,是搜索空间爆炸与冗余思考。团队认为,推理效率的瓶颈并不在「算得不够多」,而在「选得不够好」。

DynaAct 将推理过程类比为决策序列:每一步的关键不是「生成什么」,而是「选择什么去执行」。

DynaAct 核心思想是将动作空间学习问题转化为集合选择问题,并通过子模优化(Submodular Optimization)来实现线性复杂度的算法。

子模优化的关键在于定义合适的子模函数(Submodular Function)。由于子模函数具备「集合越大,新增元素收益越小」的性质deepseek,因此可以贪心地构建一个子集,实现子集性质近似最优,同时算法复杂度维持在线性。

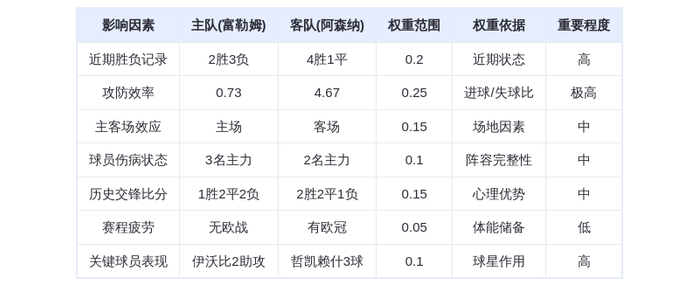

具体来说,DynaAct 定义的子模函数包括 utility 和 diversity 两个部分。前者度量动作空间与当前状态的相似度;而后者则刻画动作空间中动作的冗余度:

这样定义下的子模函数学习等价于学习动作和状态的 embedding。DynaAct 采用 Q-learning 来优化,希望利用学到的子模函数能最终选出最大化推理回报(reward)的动作空间。

在系统实现层面,团队开源了基于 vLLM 的高性能 MCTS 框架。该实现显著提升了节点扩展、Rollout 与 Reward 计算效率,为后续 TTS 研究提供了通用加速方案。

在 6 项推理基准上,DynaAct 显著优于 CoT、RAP 与 rStar 等方法,验证了动态动作空间的有效性。原文出处:NeurIPS 2025 DynaAct:DeepSeek R1之外,探索大模型推理的另一条道路,感谢原作者,侵权必删!